Agent三国的"最后一公里":Hermes、Harness和OpenClaw到底在争什么?

Agent三国的"最后一公里":Hermes、Harness和OpenClaw到底在争什么?

烟雨平生

发布于 2026-04-14 19:23:01

发布于 2026-04-14 19:23:01

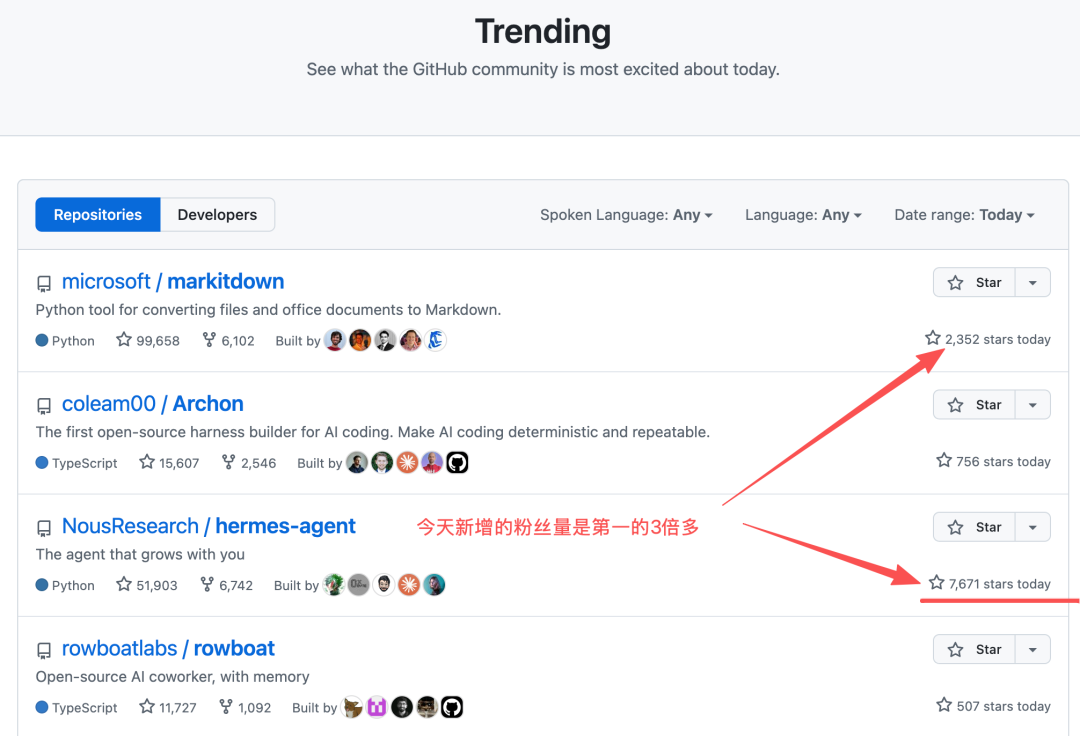

这周GitHub Trending上又杀出一个新面孔——Hermes Agent

2月底开源至今不到 2 个月,Star 数狂飙至 5.1 万 +,300 + 贡献者参与,平均 3-5 天一个大版本,已迭代至 v0.8.0。社区吵翻了天,有人喊它「2026 最强 Agent 框架」,也有人质疑是「OpenClaw 仿品」,实则是定位完全不同的竞品。

与此同时,另一个叫Harness Engineering的概念在技术圈快速蔓延。883个实体、1590条关系的知识图谱,专门研究怎么给AI Agent搭脚手架。OpenAI直接用"Harness Engineering"为题发了工程文章,Anthropic连发三篇长文拆解它。

Hermes Agent、Harness Engineering、OpenClaw。三个名字凑一起,很多人懵了:这不都是让AI帮你干活的吗?到底有啥区别?

今天拆明白。

先搞清楚一件事:这三样东西根本不在同一层

OpenClaw是个产品,是一个生态型 Agent(开箱即用、技能丰富)。装在你电脑上的个人助理,能接微信、能接飞书、能帮你搜资料写文章发推文。

它的核心卖点是"白盒记忆"——所有记忆都是Markdown文件,你打开就能看到它在想什么。1.3万个技能插件,ClawHub商店随便装。上手简单,装上就用。

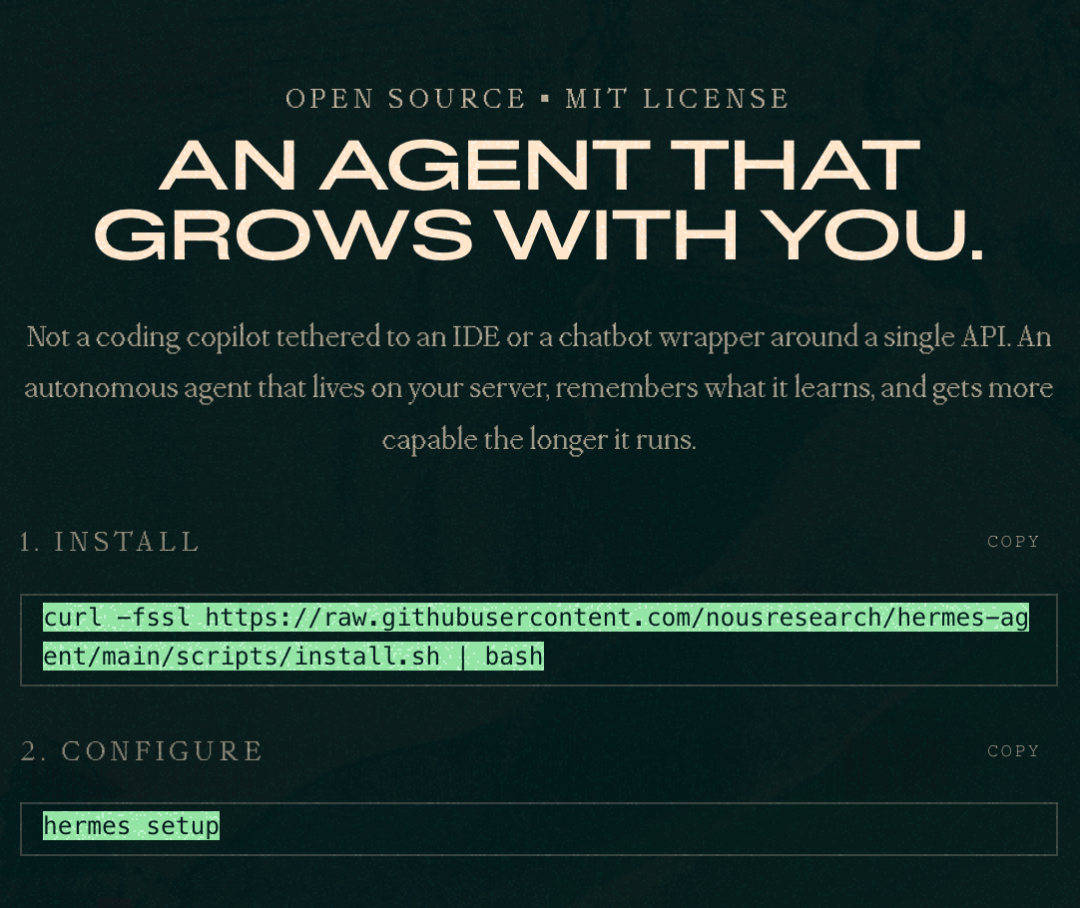

Hermes Agent是个自我进化型 Agent(越用越聪明)。一个能自己学习、自己进化、24小时不睡觉的AI打工人。

任务做成功了,自动把流程变成技能文档;做得不好,下次自己调整策略。部署在5美元的VPS上就能跑,你关了电脑它还在干活。

Harness Engineering是个方法论。研究的是"怎么给AI Agent搭环境让它靠谱干活"。模型是骑手,Agent是马,Harness就是马鞍、缰绳和围栏。没有Harness,马也会跑,但跑哪去不确定。

一句话:OpenClaw是工具箱,Hermes Agent是员工,Harness Engineering是怎么培训员工的手册。

Harness凭什么突然火了?

要理解Harness Engineering为什么在2026年突然成了热词,得先看AI工程这几年走过的一条弧线。

2022年,ChatGPT上线。 模型能生成,但不能行动。能写邮件,但发不出去。能写代码,但跑不了。工程上的产物是Prompt Engineering——怎么问才能让模型答得更好。

2023-2024年,连接时代。 Function Calling、LangChain、AutoGPT……模型从"能说"进化到"能连"。但连接不等于编排。AutoGPT那种"让模型自己跑"的尝试,全因为缺乏可靠的停止条件和验证机制,demo之后迅速沉寂。

2024年,推理模型登场。 OpenAI o1、DeepSeek-R1,数学和编程任务质的飞跃。但一个能解IMO金牌题的模型,仍然会在四小时的全栈开发任务中途"忘记自己在干什么"。

2025年,Agent元年。 Claude Code、Manus、Codex……Agent能自主工作数小时了。但Agent做到70%后宣布"已全部完成"然后停下来、多个Agent并行时小错误被级联放大、代码库出现严重"AI slop"——这些问题不是模型的智力问题,而是系统的结构问题。

2026年,治理时代。 Harness Engineering被正式命名。2月Mitchell Hashimoto写下"Engineer the Harness",OpenAI以此为题发工程文章——一个小团队五个月从零构建百万行代码仓库,工程师的工作重心变成了"设计环境、明确意图、构建反馈回路"。

说白了,Harness Engineering火起来的原因就一个:Agent能力已经到了"可以自主工作数小时"的水平,但围绕它的工程基础设施还停留在"单次对话"的时代。

Harness到底在解决什么问题?

Anthropic给出了一个精确定义:当我们评估"一个Agent"时,实际上评估的是model + harness的组合,而不是模型单独的能力。

Harness负责的是"外循环"——决定什么时候开始新的推理循环、给它什么上下文、如何验证输出、何时回退、何时停止。模型的推理是"内循环",Harness是管着内循环的那个外层系统。

它具体管六件事:

状态续航: Agent做完一半挂了,冷启动后30秒内要知道"上次做到哪了、下一步该做什么"。不是保存聊天记录,而是让Agent在零上下文的情况下能读取结构化的状态工件继续工作。

任务分解: 不能让Agent一把梭——在单个session里试图完成所有任务。Anthropic的解法是planner/generator/evaluator三角色系统,先分解再逐步执行。

反馈回路: Agent自己评价自己?Anthropic发现了一个尴尬的事实——Agent倾向于热情地自我表扬,即使质量明显平庸。需要不依赖自我评价的外部验证系统。

感知面: 凡是不在Agent运行时可见范围内的知识,就等于不存在。把logs、metrics、架构决策全部暴露给Agent查询。

工具治理: 不要让模型直接调用工具,让模型写代码来调用工具。把工具使用从模型内循环挪到更高效的外部执行回路。

熵增抑制: Agent持续产出会不断累积冗余和漂移。定期清理"AI slop"不是锦上添花,是必需品。

三者能擦出什么火花?

OpenClaw的优势是生态——1.3万个技能,接了一堆IM渠道,用户量大。但它的Agent自主能力弱,跨会话记忆容易膨胀,长时间任务跑不了。

Hermes Agent的优势是自主性——自动学习、cron调度、子Agent并行。但它的渠道接入不够丰富,技能生态还在早期。

Harness Engineering提供的知识框架——上下文工程、安全边界、可观测性——恰好是两边的短板。OpenClaw缺的"自主性"和"长时间任务执行",用Harness的方法论可以系统化补强。Hermes Agent缺的"安全边界"和"可控性",恰恰是Harness最擅长设计的。

LangChain做过一个硬核验证:保持底层模型不变,仅通过修改harness,把Terminal Bench 2.0上的得分从52.8%拉到66.5%——同一模型,harness拉开13.7分差距。护城河正在从模型质量上移到系统设计。

所以这三者的关系不是竞争,是互补:

- OpenClaw负责触达用户(IM渠道、技能市场)

- Hermes Agent负责持续进化(自主学习、长时间执行)

- Harness Engineering负责可靠性(安全、可观测、评估)

都只是"最后一公里"吗?

Agent圈有个流行说法:"大模型已经很强了,Agent只是最后一公里的胶水代码。"

这是错的。

大模型确实越来越强。但"一个会思考的大脑"和"一个能干活的员工"之间,隔着三道坎:

第一道坎:记忆。 大模型每次对话从零开始。你说"帮我跟踪这个PR",它明天就忘了。OpenClaw用Markdown文件记忆,Hermes用SQLite+FTS5全文检索,都是在解决同一个问题——让AI有跨时间的上下文。但Harness Engineering指出,真正的状态管理不是"保存聊天记录",而是让Agent冷启动后30秒内能续航的结构化工件。

第二道坎:工具。 MCP生态爆发后,一个Agent可能连接几十个工具。但直接把所有工具定义塞进上下文,Agent在工具海洋里反而迷失方向。Harness的解法是:不让模型直接调工具,让模型写代码来调工具。工具发现、数据过滤全在执行环境内完成,不进上下文。

第三道坎:安全。 Invariant Labs在2025年披露了Tool Poisoning Attacks——恶意指令藏在MCP工具描述里,对用户不可见,却对模型可见,诱导Agent执行未授权操作。一个能24小时自主运行的Agent,如果跑偏了怎么办?Harness的权限模型必须从静态的"可以/不可以"升级为动态的"在什么条件下可以、需要人类确认后才可以"。

这不是最后一公里。这是一条才刚开始修的高速公路。

我的判断

短期内,OpenClaw更实用。装上就能用,技能生态成熟,IM渠道齐全。日常自动化够用。

中期看,Hermes Agent的自主进化能力会拉开差距。一个能自己学习、自己改进的Agent,跟一个只会执行预设流程的Agent,长期效率差一个数量级。

长期来看,谁先把Harness Engineering的方法论融入产品——谁能在"聪明"和"靠谱"之间找到平衡——谁就赢。

工程师的角色也在变。不满意Agent输出时,低层做法是手改产物;高层做法是改harness,让系统下次自动做得更好。从in the loop到on the loop,这才是工程师在Agent时代的核心升级路径。

现在这三个项目都在快速迭代。OpenClaw刚合并了图片上传的PR,Hermes Agent一个月4个大版本,Harness Engineering的知识图谱已经覆盖883个实体。

这场仗才刚打起来。

⚠️ 踩坑提醒:别被GitHub Star数忽悠了。51K Star不代表51K用户。Agent项目的活跃贡献者数量比Star更有参考价值。

💡 一句话带走:护城河正在从模型质量上移到Harness设计——同一模型,不同的harness能拉开13分的差距。

你更看好哪个方向?是"可控的助手"还是"自主的打工人"?评论区聊聊你的想法。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-04-11,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读