本文提出一种个性化大模型框架,通过持久化记忆(STM/LTM/摘要/用户画像)和多智能体协作(协调/检索/验证/生成)实现自适应、连续性、定制化对话。系统将当前任务、历史交互与用户偏好融入决策上下文,通过反思校验提升回答质量,在长对话场景表现优异。未来将解决冷启动与主动性,使大模型从"会搜"进化为"懂你"。

前排提示,文末有大模型AGI-CSDN独家资料包哦!

RAG能搜资料,却很难认识你。这套框架用持久化记忆 + 动态用户画像 + 多智能体协作,把一次次聊天变成可累积的个性化能力。

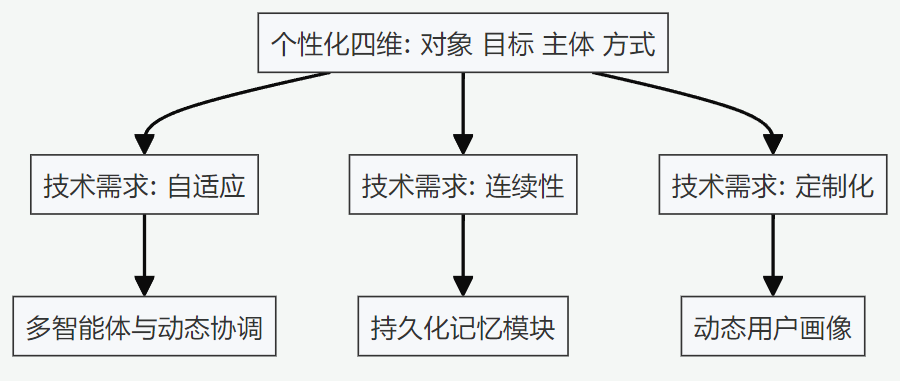

1 个性化原理

对象/目标/主体/方式四维定义,映射为三条硬性技术需求:自适应、连续性、定制化。

1.对象是被个性化的输出(内容/功能/风格),目标是满足个人需求与体验提升。

2.主体既有显式(用户告诉系统)也有隐式(系统自动学习),因此必须有可演化的记忆与可更新的用户画像。

3.从原理看,本质是把当前任务 + 历史交互 + 用户偏好转为决策的上下文,驱动不同检索与推理策略。

4.工程落地需要把概念→约束→组件严格映射,避免停留在体验层描述。

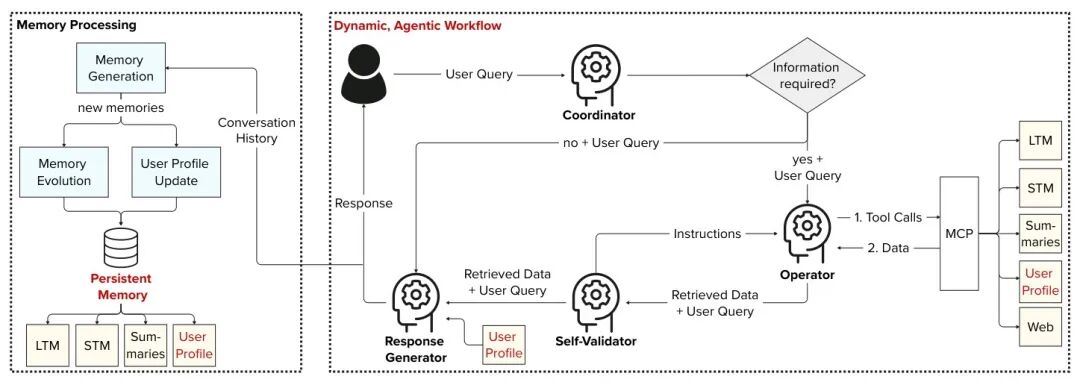

2 多智能体实现

框架以LLM为中枢,落地六大Agentic模式:中央协调、规划、跨源检索、多智能体协作、反思校验、持久记忆。

1.Coordinator按任务复杂度决策:简单问答直达生成,复杂问题转Operator做检索与工具调用。

2.Operator通过MCP统一接口调用STM/LTM/对话摘要/用户画像/网页搜索,实现多源可插拔检索。

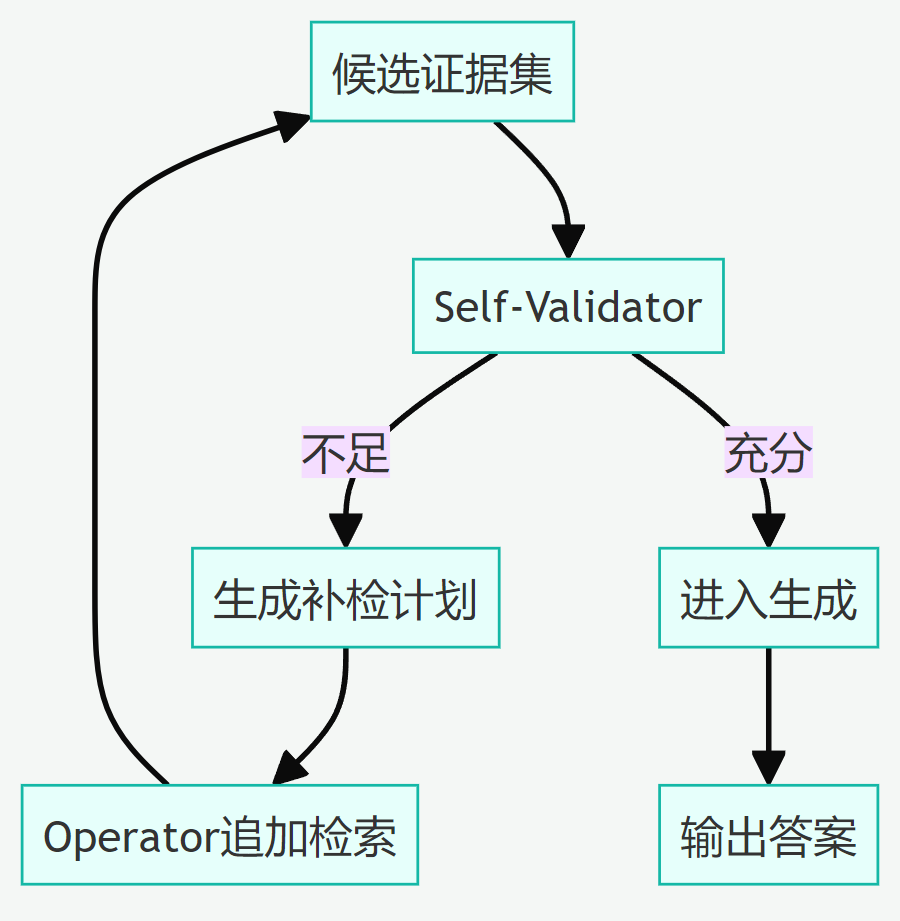

3.Self-Validator执行反思式校验,不足则回指令让Operator追加检索,形成检索—验证—再检索闭环。

4.Response Generator用用户画像控制语气、粒度与示例,输出对人对事双对齐的答案。 #### 目标:满足“自适应”要求,随用户语境与任务复杂度动态调整。

关键模式:中央协调、规划、多源检索、多代理协作、反思、持久记忆。

工作流:协调器分流请求;操作员以 RAG+MCP 访问 LTM/STM/会话摘要/用户画像/网页并择优组合;自验证器检查充分性与一致性并迭代改进;响应生成器结合用户画像输出个性化结果。

价值:以角色化提示与历史对齐,实现上下文敏感、可重复、稳健且以用户为中心的系统行为。

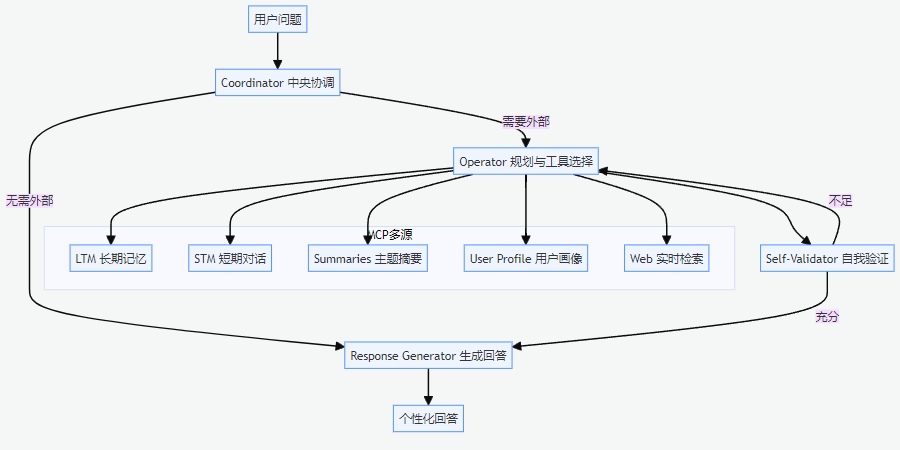

图示工作流:从提问到个性化响应的全链路

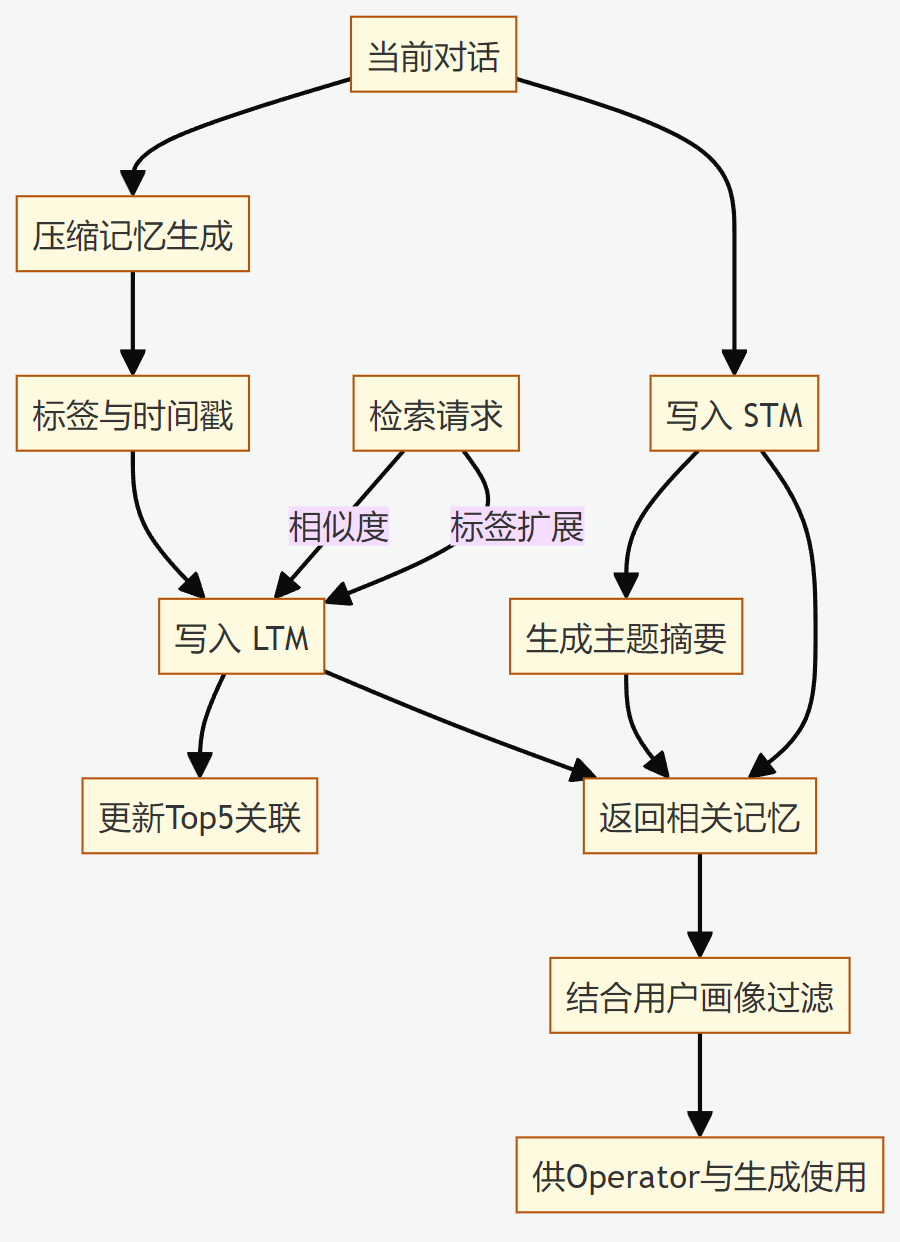

3 持久记忆四件套

记忆不是一个向量库,而是时间尺度 + 表征形态的协同:

1.STM保存最近轮次全文,确保即时上下文;对话积累后由摘要器生成主题摘要,覆盖更长跨度。

2.LTM存压缩记忆(摘要向量+标签+时间戳+前5相关记忆),写入时回流更新关联,仿照人类巩固。

3.用户画像是结构化JSON,记录偏好、语气、兴趣、目标,由LLM隐式更新,用于检索过滤与风格控制。

4.检索时采用相似度+标签扩展双通道,既准又广,减少只像不对的相似度陷阱。

4 反思校验

仅有检索仍会漏信息或拼贴,Self-Validator通过可用性/一致性/特异性三问来兜底:

1.若证据不足或矛盾,返回精确拉取指令(要什么、从哪拉、补充到何处),驱动二轮检索。

2.在碎片化记忆场景,反思能显著提升上下文充分性,减少看似相关但答非所问。

3.验证也要节制:当结果已充分时放行,避免过度反思带来的时延。

图示反思回路:不足则返工,充分则生成

5 评测要点与实践

在GVD、LoCoMo、LongMemEval三套数据上,对比标准RAG与消融(去掉协调/验证/画像)。

1.总体上,检索准确率与回答正确率优于或持平RAG,尤其长对话任务提升显著。

2.去掉用户画像,检索与正确率均下滑,说明画像不仅调风格,更直接影响取数与判断。

3.协调器/自我验证收益受模型与数据分布影响,在人类噪声场景预期价值更高。

4.自动指标(ROUGE、BertScore)与人类目标弱相关,个性化评测应以检索命中、正确性、连贯性为主。

从第一性原理看,个性化=把当前任务+历史交互+个人画像注入决策上下文;

工程上以多智能体工作流实现自适应,用STM/摘要/LTM/画像保证跨会话连续,用自我验证把不确定性转为可靠答案;

评测则以检索命中、答案正确、对话连贯三指标为主,结合少量人工标注,更贴近真实体验。

下一步实践,重点解决冷启动(轻量化画像初始化)与主动性(系统适时追问与建议),让会搜的模型真正进化成懂你的助理。

读者福利:倘若大家对大模型感兴趣,那么这套大模型学习资料一定对你有用。

针对0基础小白:

如果你是零基础小白,快速入门大模型是可行的。

大模型学习流程较短,学习内容全面,需要理论与实践结合

学习计划和方向能根据资料进行归纳总结

包括:大模型学习线路汇总、学习阶段,大模型实战案例,大模型学习视频,人工智能、机器学习、大模型书籍PDF。带你从零基础系统性的学好大模型!

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

👉AI大模型学习路线汇总👈

大模型学习路线图,整体分为7个大的阶段:(全套教程文末领取哈)

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉大模型实战案例👈

光学理论是没用的,要学会跟着一起做,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

👉大模型视频和PDF合集👈

这里我们能提供零基础学习书籍和视频。作为最快捷也是最有效的方式之一,跟着老师的思路,由浅入深,从理论到实操,其实大模型并不难。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

481

481

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?