个人成就

-

获得11,727次点赞

-

内容获得143次评论

-

获得16,176次收藏

-

代码片获得64,219次分享

-

博客总排名19,942名

-

TA的专栏

-

大模型 36篇

大模型 36篇

TA关注的专栏 0

TA关注的收藏夹 0

TA关注的社区 0

TA参与的活动 0

TA的推广

兴趣领域

设置

- 人工智能

opencv数据挖掘语音识别计算机视觉目标检测机器学习人工智能caffe深度学习神经网络自然语言处理sklearncnnmllibword2vectensorflow目标跟踪keras知识图谱rnnlstm自动驾驶dnn生成对抗网络mxnetpytorch机器翻译语言模型oneflowmlnetpaddlepaddlegrumnnboostingtransformerxlnetbertopenvino边缘计算超分辨率重建智慧城市视觉检测图像处理nlp数据分析scikit-learn聚类集成学习迁移学习分类回归gpt-3spark-mlAI作画tf-idfstable diffusionchatgptDALL·E 2craiyonImagenDreamFusionAudioLMYOLObard文心一言ocr

opencv数据挖掘语音识别计算机视觉目标检测机器学习人工智能caffe深度学习神经网络自然语言处理sklearncnnmllibword2vectensorflow目标跟踪keras知识图谱rnnlstm自动驾驶dnn生成对抗网络mxnetpytorch机器翻译语言模型oneflowmlnetpaddlepaddlegrumnnboostingtransformerxlnetbertopenvino边缘计算超分辨率重建智慧城市视觉检测图像处理nlp数据分析scikit-learn聚类集成学习迁移学习分类回归gpt-3spark-mlAI作画tf-idfstable diffusionchatgptDALL·E 2craiyonImagenDreamFusionAudioLMYOLObard文心一言ocr

创作活动更多

AI 镜像开发实战征文活动

随着人工智能技术的飞速发展,AI 镜像开发逐渐成为技术领域的热点之一。Stable Diffusion 3.5 FP8 作为强大的文生图模型,为开发者提供了更高效的图像生成解决方案。为了推动 AI 镜像开发技术的交流与创新,我们特此发起本次征文活动,诚邀广大开发者分享在 Stable Diffusion 3.5 FP8 文生图方向的实战经验和创新应用 本次征文活动鼓励开发者围绕 Stable Diffusion 3.5 FP8 文生图方向,分享以下方面的内容: 1. 技术实践与优化 - Stable Diffusion 3.5 FP8 模型架构解析与优化技巧 - 文生图生成效果的提升方法与技巧 - 模型部署与加速策略,例如使用 Hugging Face、Diffusers 等工具 - 针对特定场景(例如二次元、写实风)的模型微调与定制化开发 2. 应用场景探索 - Stable Diffusion 3.5 FP8 在不同领域的应用案例分享,例如游戏设计、广告创意、艺术创作等 - 利用 Stable Diffusion 3.5 FP8 实现图像编辑、图像修复、图像增强等功能的探索 - 结合其他 AI 技术(例如 NLP、语音识别)构建更强大的应用 3. 创新应用与思考 - 基于 Stable Diffusion 3.5 FP8 的创新应用场景设计 - AI 镜像开发的未来发展方向的思考与展望 - 对 AI 镜像开发伦理、安全等问题的探讨

28人参与 去参加

- 最近

- 文章

- 专栏

- 代码仓

- 资源

- 收藏

- 关注/订阅/互动

更多

最近

文章

专栏

代码仓

资源

收藏

关注/订阅/互动

社区

帖子

问答

课程

视频

搜索 取消

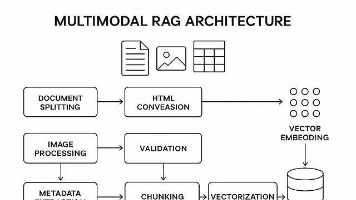

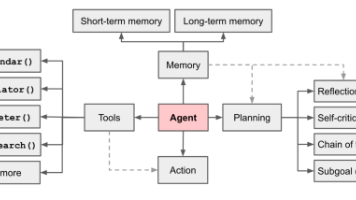

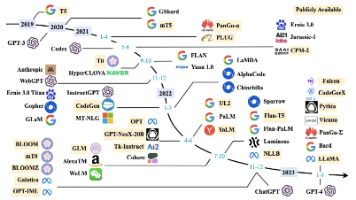

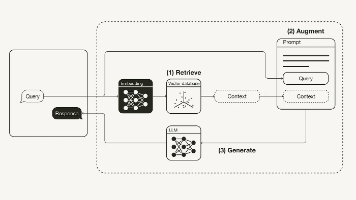

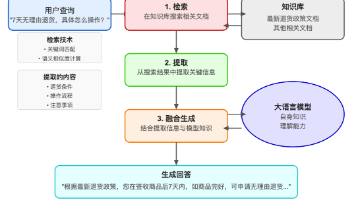

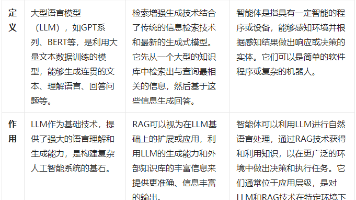

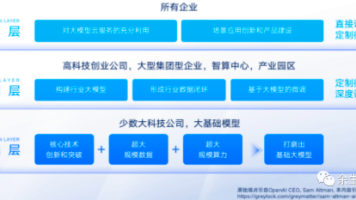

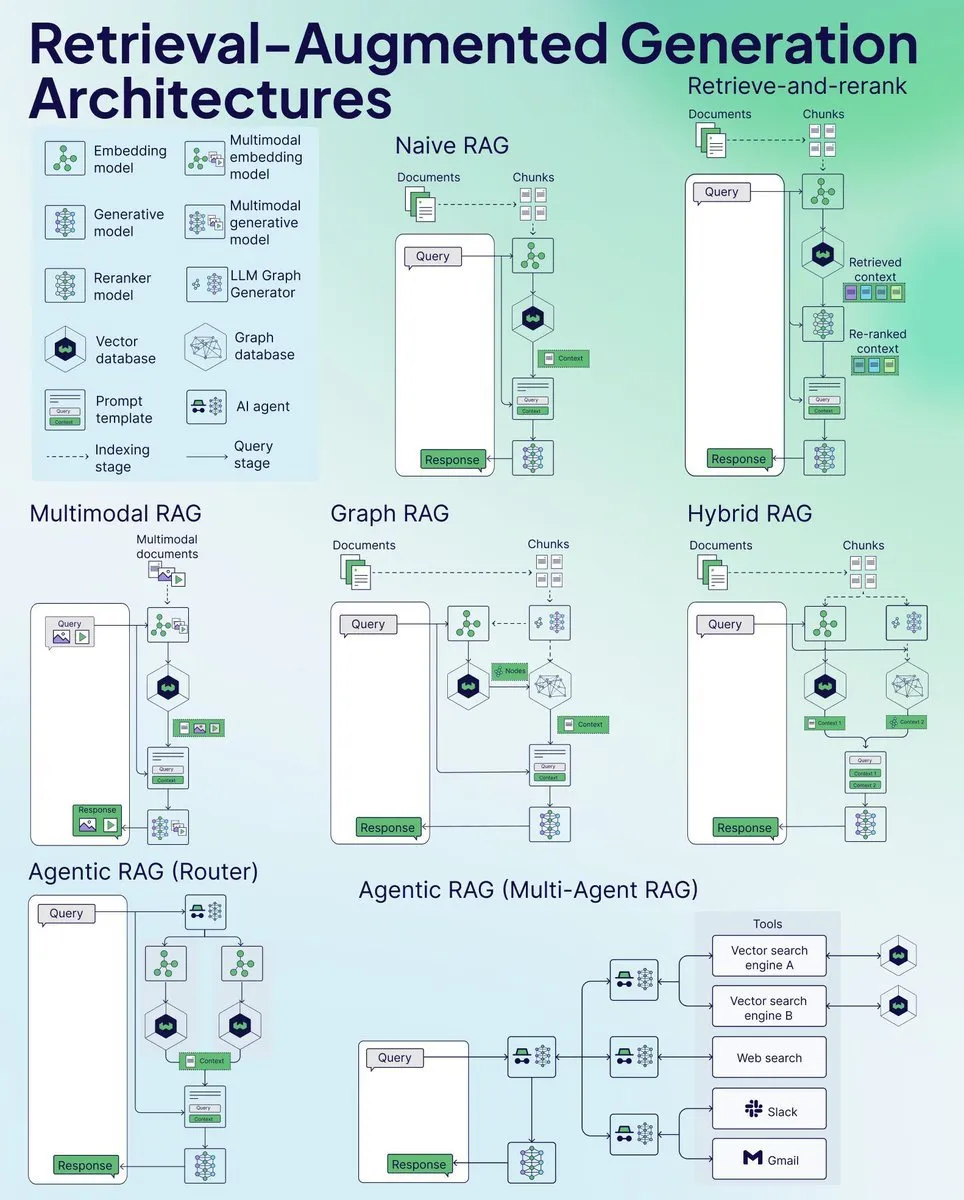

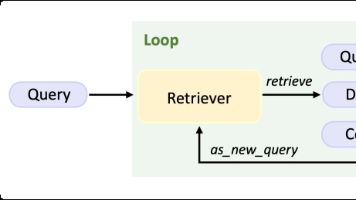

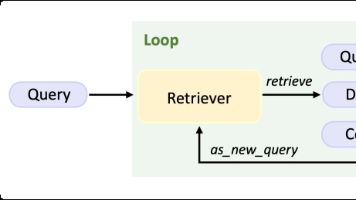

UltraRAG 2.0是基于MCP架构的RAG框架,通过YAML声明式配置实现复杂逻辑,仅需传统框架5%代码量。它提供组件化封装、灵活扩展和轻量流程编排,支持多阶段推理系统,在复杂多跳问题上性能提升约12%。该框架显著降低开发门槛,让研究者专注于算法创新,适用于智能客服、教育辅导等多种场景。